Ich weiss ich weiss: die ganze Welt spricht derzeit über GPT4o neues Bildmodell und auch über Gemini 2.5 - und versprochen, wir sprechen darüber, aber nicht heute. Aus dem einfachen Grund: ich mag keine Hypes, ich mag Anwendungsfälle und Hintergründe und wenn Du mir folgst, dann wohl aus dem Grund, um zu lernen UND zu verstehen, nicht um noch mehr Tools und News zu lesen.

GPT-4o brilliert gerade mit viel realistischer Bild- und Textgenerierung und nahtloser ChatGPT-Integration, während Gemini 2.5 Pro mit einem gigantischen Kontextfenster von 1 Million Tokens und überragendem Reasoning punktet. Diese Entwicklungen revolutionieren nicht nur kreative Prozesse und Programmierung, sondern setzen neue Standards für multimodale KI-Anwendungen in Unternehmen und Forschung.

Und während OpenAI im Bereich der visuellen Kreativität führend ist, setzt Googles Gemini 2.5 Pro neue Massstäbe in Bezug auf Reasoning-Fähigkeiten und Kontextverarbeitung. Ein Kontextfenster von einer Million Tokens, das in naher Zukunft sogar auf zwei Millionen erweitert werden soll. Zum Vergleich: Claude 3 arbeitet mit 200’000 und GPT-4 Turbo mit 128’000 Tokens. Diese enorme Kapazität ermöglicht es, ganze Code-Repositories oder Buchmanuskripte in einem einzigen Durchlauf zu verarbeiten, was die Art und Weise, wie wir mit umfangreichen Datenmengen interagieren, grundlegend verändert.

Aber ich werde darüber sprechen - in meinem Podcast spreche ich heute über GPT-4o und auf dem Digital Business Update schreibe ich nächste Woche über Gemini 2.5 auf LinkedIn. Heute aber gehts um was anderes: Um das KI Dilemma und was dahinter steckt: synthetische Daten, Open-Source und die Kosten.

Also der Reihe nach.

Heute ist es KI - morgen ist es einfach Software

Als ich letzte Woche mit der Inhaberin eines mittelständischen Unternehmens nach einem Workshop noch kurz sprach, stellte sie mir eine Frage, die ich schon oft gehört hatte: "Muss ich wirklich 100’000.- im Jahr für KI-Dienste ausgeben mit Copilot oder ChatGPT, oder gibt es Alternativen? Und wie sicher ist das nun wirklich?"

Diese oben gestellte Frage zeigt ein weit verbreitetes Dilemma in der Geschäftswelt. Künstliche Intelligenz transformiert Branchen in atemberaubendem Tempo – Wir sprechen vom Kundenservice, zum Marketing, vom Controlling bis zur Produktentwicklung.

Doch während viele Technologieriesen wie Microsoft und Co. ihre geschlossenen KI-Systeme zu Premium-Preisen anbieten (teilweise wohl auch zurecht), bleiben viele (nicht nur Führungskräfte) im Ungewissen: Gibt es einen anderen Weg? Ja, den gibt es. Und dieser Weg könnte auch deinem Unternehmen nicht nur Kosten sparen, sondern auch die Kontrolle über deine wertvollsten Daten zurückgeben.

Denken wir mal an die frühen Tage des Internets, als nur grosse Unternehmen Web-Präsenzen unterhalten konnten. Heute kann jede:r eine Website erstellen. Mit KI erleben wir eine ähnliche Revolution – was gestern nur den Tech-Giganten vorbehalten war, kann heute und in Zukunft mit noch mehr erstaunlich zugänglicher Hardware auf dem eigenen Server laufen.

Darum nehme ich dich heute mit auf eine Reise ins Innere moderner KI-Systeme und ich versuch es so verständlich wie möglich:

✅ Wie KI-Modelle tatsächlich lernen

✅ Was der revolutionäre "Attention-Mechanismus" bewirkt

✅ Welche drei fundamentalen Schwächen moderne KI hat

✅ Wie ihr wir wenig Kapital eine eigene KI lokal betreiben können (mit Open-Source)

Wie werden KI-Modelle überhaupt trainiert?

Viele von uns nutzen täglich KI-Systeme wie ChatGPT oder Bildgeneratoren, aber der Weg dahin bleibt oft im Dunkeln. Gemeinsam schauen wir uns an, was hinter dem "Training" einer KI steckt. Den Trainingsprozess können wir in drei wesentliche Schritte unterteilen:

Schritt 1: Das Fundament legen

Zunächst müssen wir das Grundgerüst des Modells entwerfen – ähnlich wie ein Architekt einen Bauplan erstellt. Wir entscheiden über die Struktur: wie viele "Neuronen" (mathematische Funktionen) unser künstliches Gehirn haben soll und wie diese miteinander verbunden sind. Je nach Aufgabe wählen wir unterschiedliche Strukturen für die Large Language Modelle (kurz LLM) – ein Bilderkennungsmodell ist übrigens anders aufgebaut als ein Textmodell.

Schritt 2: Die Lernphase

Hier kommt der spannende Teil: Wir füttern unser Large Language Modell mit enormen Datenmengen. Für Sprachmodelle wie GPT sind das:

Milliarden von Textdokumenten aus dem Internet

Bücher, Artikel, Webseiten, Foren

Wissenschaftliche Publikationen

Warum so viele Daten? Weil eine KI Muster "lernen" muss, was in diesen Trainingsdaten enthalten ist. Sie lernt Muster zu erkennen: welche Wörter häufig zusammen auftreten, wie Sätze aufgebaut sind oder wie auf bestimmte Fragen typischerweise geantwortet wird.

Beim Training verwenden wir dabei verschiedene Lernmethoden:

Überwachtes Lernen: Wir zeigen dem Modell Beispiele mit den "richtigen" Antworten. Denken wir an eine:n Lehrer:In, die/der Hausaufgaben korrigiert und Feedback gibt.

Unüberwachtes Lernen: Hier bekommt das Modell nur die Daten ohne Lösungen und muss selbst Zusammenhänge finden. Grosse Sprachmodelle lernen oft, indem sie versuchen, das nächste Wort in einem Text vorherzusagen.

Verstärkendes Lernen mit menschlichem Feedback: Nach dem Basistraining bewerten Menschen die Antworten des Modells. "Das war hilfreich" oder "Das war unpassend" – so lernt das Modell, die eigenen Ausgaben zu verbessern. Aber Achtung: es geht hier selten um “Wahrheit” oder “Real Politik”, es geht um das Sprachverständnis im Kontext. Für alles andere (Live Daten oder spezialisierte Daten-Inputs gibt es Plugins, Zusatzsoftware oder Schnittstellen)

Eine KI funktioniert wie eine Bibliothekarin, die Millionen Bücher gelesen hat und ein perfektes Gedächtnis besitzt. Sie kann beeindruckend Sätze vervollständigen und Textmuster nachahmen, aber sie hat einen entscheidenden Nachteil: Sie kennt die Welt nur aus Büchern.

Fragt man sie nach dem Geschmack einer Frucht oder dem aktuellen Wetter, kann sie nur raten – basierend auf ähnlichen Beschreibungen, die sie gelesen hat. Sie hat nie selbst etwas geschmeckt oder nach draussen geschaut.

Diese fundamentale Einschränkung führt dazu, dass KI-Modelle bei Fragen ausserhalb ihres "Buchwissens" unvermeidlich Dinge erfinden – sie berechnen nur, wie eine plausible Antwort klingen müsste, ohne echtes Verständnis.

Schritt 3: Die Anwendung

Nach abgeschlossenem Training ist unser LL-Modell praktisch einsatzbereit. Es kann jetzt sein erlerntes Kontext-Verständnis auf neue, unbekannte Anfragen anwenden – sei es die Beantwortung einer Frage, das Verfassen eines Textes oder die Analyse eines Bildes. Und Du kannst es auch nutzen - als Software in ChatGPT, oder bei Google Gemini oder in Copilot bei deinem M365.

Der Attention-Mechanismus: Die revolutionäre Idee hinter modernen Sprachmodellen (LLM & GPT)

Der Attention-Mechanismus ist der Durchbruch, der moderne KI-Systeme so leistungsfähig macht. 2017 von Forschern bei Google entwickelt, bildet er das Herzstück der Transformer-Architektur, auf der Modelle wie GPT (Generative Pre-trained Transformer) und BERT (Bidirectional Encoder Representations from Transformers). Das sind zwei einflussreiche Architekturen für Sprachmodelle, die beide auf dem Transformer-Mechanismus basieren, aber unterschiedliche Ansätze verfolgen.

Aber wie funktioniert dieser Mechanismus? Denken wir an unser eigenes Lesen: Wenn wir einen komplexen Satz verstehen wollen, achten wir auf Zusammenhänge zwischen verschiedenen Wörtern, auch wenn sie weit voneinander entfernt stehen.

Ein Beispiel: "Die Katze, die der Hund, den mein Nachbar gestern adoptiert hat, gejagt hat, ist auf den Baum geklettert."

Um diesen Satz zu verstehen, müssen wir Verbindungen zwischen "Katze" und "geklettert" herstellen, obwohl viele Wörter dazwischen liegen. Genau das ermöglicht der Attention-Mechanismus in KI-Modellen.

Im technischen Sinne funktioniert er wie ein ausgeklügeltes Nachrichtensystem:

Ein Wort (oder Token) sendet eine "Anfrage" (Query) an alle anderen Wörter

Jedes Wort antwortet mit einem "Schlüssel" (Key) und einem "Wert" (Value)

Durch Berechnung der Ähnlichkeit zwischen Anfrage und Schlüsseln entsteht ein "Aufmerksamkeitsgewicht"

Die Werte werden entsprechend dieser Gewichte kombiniert

Es gibt verschiedene Arten, wie Modelle Attention einsetzen:

GPT-Modelle (wie ChatGPT) verwenden "autoregressive Attention" – sie sehen nur vorherige Wörter, wenn sie das nächste Wort vorhersagen. Diese Einschränkung ist bewusst so gestaltet, damit das Modell lernt, selbständig Text zu generieren.

BERT-Modelle nutzen "bidirektionale Attention" – sie betrachten Wörter in beide Richtungen (vor und nach dem aktuellen Wort). Dies macht BERT besonders gut im Verstehen von Kontext und Textbedeutung, aber weniger geeignet für die Textgenerierung.

T5-Modelle kombinieren beide Ansätze in einem "Encoder-Decoder"-Format, was sie vielseitiger macht.

Die drei Achillesfersen moderner KI

Trotz aller Fortschritte kämpfen KI-Systeme mit drei grundlegenden Schwächen: einer Knappheit hochwertiger Trainingsdaten, der Spiegelung gesellschaftlicher Vorurteile aus ihren Trainingsdaten und begrenzten Wissensfähigkeiten bei spezifischen oder komplexen Themen.

1. Die Datenkrise: Qualität und Knappheit

Unsere KI-Modelle sind nur so gut wie die Daten, mit denen wir sie trainieren. Das Problem: Hochwertige Trainingsdaten werden knapp. Expert:Innen haben vorhergesagt, dass spätestens 2026 eine ernsthafte Datenknappheit droht. Also Ende diesen Jahres.

Grosse KI-Unternehmen haben bereits Verträge mit Verlagen wie der Harvard Universität oder grosen Verlagen wie Bertelsmann, Springer oder der New York Times geschlossen, um an deren Inhalte zu gelangen. Doch diese wachsen zu langsam für den steigenden Bedarf.

2. Voreingenommenheit und Diskriminierung

KI-Systeme spiegeln unweigerlich die Vorurteile wider, die in ihren Trainingsdaten enthalten sind. Dies kann zu diskriminierenden Ergebnissen führen – sei es bei der Gesichtserkennung, Kreditvergabe oder Personalauswahl.

Ein bekanntes Beispiel ist die KI-basierte Gesichtserkennung, die bei Menschen mit dunkler Hautfarbe deutlich schlechter funktioniert als bei Menschen mit heller Haut. Selbst mit speziell entwickelten diversen Datensätzen erreichen die besten Systeme nur eine 99%-Genauigkeit, mit signifikanten Unterschieden zwischen demographischen Gruppen.

3. Begrenzte Wissensfähigkeiten

Die dritte Schwachstelle betrifft das "Wissen" der KI. Sprachmodelle können zwar beeindruckend formulieren, aber ihre Informationen sind:

Begrenzt auf den Zeitpunkt des Trainings (Wissens-Cutoff)

Oft ungenau bei Spezialwissen

Schwach bei komplexen historischen oder wissenschaftlichen Zusammenhängen

Eine aktuelle Studie zeigte, dass selbst führende Sprachmodelle wie GPT-4 bei komplexen historischen Fragen nur eine Genauigkeit von rund 46% erreichten. Sie funktionieren gut bei grundlegenden Fakten, scheitern aber bei tiefergehenden Analysen.

Das RAG: Die Rettung für Wissenslücken und für deine Firma

Eine vielversprechende Lösung für diese Probleme ist die "Retrieval-Augmented Generation" (RAG). Was steckt dahinter?

RAG kombiniert die Stärken eines Sprachmodells mit der Genauigkeit externer Datenquellen. Statt sich ausschliesslich auf sein "gelerntes Wissen" zu verlassen, greift das System aktiv auf eine Wissensdatenbank zu:

Der/Die Nutzer:In stellt eine Frage

Das System durchsucht seine Datenbank nach relevanten Informationen

Die gefundenen Fakten werden zusammen mit der Frage an das Sprachmodell übergeben

Das Modell formuliert eine Antwort, die auf den bereitgestellten Fakten basiert

Die Vorteile liegen auf der Hand:

Reduzierung von Halluzinationen (erfundenen Fakten)

Integration von aktuellem Wissen ohne Neutraining

Einbindung firmeneigener Informationen ohne Datenweitergabe

Für Unternehmen ist dies besonders wertvoll: Sie können ihre internen Dokumente, Handbücher oder Wissensdatenbanken in ein RAG-System einspeisen und erhalten so einen KI-Assistenten, der präzise auf Basis ihrer eigenen Informationen antwortet.

NotebookLM ist so ein RAG:

Lokale KI-Lösungen: RAG’s mit deiner Hardware, die Kosten und praktische Umsetzung

Und jetzt kombinieren wir alles. Denn Du kannst auch RAG’s bei dir einführen. Dank der Fortschritte bei Open-Source-Modellen können wir heute viele KI-Anwendungen lokal auf eigener Hardware betreiben. Was brauchen wir dafür?

Hier gibts meinen Artikel etwas ausführlicher dazu:

Hardware-Anforderungen:

Für einfache Textgenerierung mit kleineren Modellen (7-13 Milliarden Parameter):

CPU: Moderner Prozessor mit mindestens 8 Kernen

RAM: 16-32 GB Arbeitsspeicher

GPU: Vorteilhaft, aber nicht zwingend erforderlich. Eine Nvidia RTX 3060 (8GB VRAM) oder besser beschleunigt die Verarbeitung deutlich

Speicherplatz: 10-20 GB für die Modellgewichte

Für anspruchsvollere Anwendungen oder grössere Modelle:

CPU: High-End-Prozessor mit 12+ Kernen

RAM: 64-128 GB

GPU: Nvidia RTX 4070 Ti (12GB VRAM) oder besser, idealerweise mehrere GPUs

Speicherplatz: 50+ GB SSD-Speicher

Kostenübersicht:

Einstiegslösung: bis 10’000.- für ein System mit grundlegenden KI-Fähigkeiten

Mittelklasse: bis 20’000 für ein System, das die meisten Modelle flüssig ausführen kann

Professionell: ab 20’000 CHF für Systeme zum Training eigener Modelle

Im Vergleich dazu können die Kosten für Cloud-basierte KI-Dienste bei intensiver Nutzung schnell in die Tausende pro Monat gehen. (Achtung, das sind alles sehr, sehr grobe Angaben und ja es geht immer günstiger oder teurer - zu Risiken und Nebenwirkungen, schreib mir eine E-Mail).

Für RAG-Funktionalität kombinieren wir Ollama mit Software wie LangChain, die die Indexierung und Abfrage von Dokumenten übernimmt. Und simple Komplettlösungen wie Msty bieten einen schnellen benutzerfreundlichen Zugang ohne tiefgreifende Programmierkenntnisse.

Was bedeutet das für die Zukunft? KI-Souveränität wird zum Wettbewerbsvorteil

Die KI-Landschaft hat sich in den letzten Monaten dramatisch verändert. Hier ist, was wir als Entscheidungsträger wissen sollten. Denn die jüngste Version des Ollama Enterprise Framework hat die Installation lokaler KI-Modelle revolutioniert. Was früher komplex war, ist heute fast automatisiert. Selbst kleinere Unternehmen ohne IT-Abteilungen können jetzt:

RAG-Systeme implementieren, die ihr Unternehmenswissen erschliessen

Massgeschneiderte KI-Assistenten für interne Prozesse einrichten

Sensible Daten analysieren, ohne sie weiterzugeben

Die neuesten Open-Source-Modelle wie Mistral Mixtral 2.0 und Llama 3.1 bieten uns Fähigkeiten, die vor einem Jahr nur den grössten kommerziellen Modellen vorbehalten waren. Mit lokaler Hardware können wir diese für einen Bruchteil der Kosten kommerzieller Cloud-Dienste betreiben.

Kosten-Nutzen-Rechnung im Jahr 2025

Die anfängliche Frage "Müssen wir wirklich 100'000.- im Jahr für KI-Dienste ausgeben?" können wir heute mit einem klaren "Nein" beantworten. Unsere aktuelle Kostenkalkulation zeigt:

Einmalige Investition von 15’000-20’000.- in Hardware

Jährliche Betriebskosten von ca. 5.000 CHF für Strom und Wartung

Keine Gebühren pro Token oder Anfrage

Vollständige Kontrolle über unsere Datensicherheit und -souveränität

Bei intensiver Nutzung amortisiert sich diese Investition typischerweise bereits nach 6-12 Monaten im Vergleich zu Premium-Cloud-Diensten. Besonders bemerkenswert: Die Skalierbarkeit lokaler Lösungen ist heute deutlich besser als noch vor einem Jahr, wodurch auch grössere Teams effizient arbeiten können.

Hybride Strategien als pragmatischer Ansatz

Die Erfahrungen der letzten Monate zeigen, dass ein hybrider Ansatz für die meisten von uns am sinnvollsten ist. Wir kombinieren dabei die Stärken beider Welten:

Lokale Modelle für die tägliche Arbeit und sensible Unternehmensdaten und Fine-Tuning von diesen Open-Source-Modellen für unternehmensspezifische Anwendungsfälle

Spezialisierte Cloud-Dienste für hochkomplexe Aufgaben oder sehr grosse Datensätze

Diese hybride Strategie ermöglicht es uns, das Beste aus beiden Welten zu nutzen: die Kostenkontrolle und Datensouveränität lokaler Lösungen sowie die Spitzenleistung spezialisierter Cloud-Dienste für besonders anspruchsvolle Aufgaben.

Und ja: Bei den Open-Source-Modellen führt derzeit DeepSeek R1 das Feld an. Es bietet eine Leistung, die mit proprietären Modellen wie GPT-4 mithalten kann, und das bei deutlich geringeren Trainingskosten. DeepSeek R1 ist besonders stark in Bereichen wie Mathematik und Programmierung. Weitere wichtige offene Modelle sind Llama 3 von Meta, BLOOM von Hugging Face, Falcon 2 vom Technology Innovation Institute in Abu Dhabi und Vicuna-13B von LMSYS ORG.

Auf der proprietären Seite gibt es zwei Hauptakteure: GPT-4o von OpenAI, veröffentlicht am 25. März 2025, ist ein multimodales Modell, das Text, Bilder und Audio verarbeiten kann. Es verfügt über ein beeindruckendes Kontextfenster von 128.000 Tokens und bietet für zahlende Nutzer sogar native Bildgenerierung.

Google's Gemini 2.5 Pro, angekündigt am 26. März 2025, setzt hingegen auf verbesserte Reasoning-Fähigkeiten und Codegenerierung. Mit einem Kontextfenster von 1 Million Tokens (mit einer geplanten Erweiterung auf 2 Millionen) führt es besonders in Mathematik, Wissenschaft und logischem Denken die Benchmarks an.

Für uns als Nutzer:Innen bedeutet diese Entwicklung, dass wir jetzt tatsächlich eine echte Wahl haben: Wir können entweder auf kostspielige, aber hochoptimierte proprietäre Dienste setzen oder leistungsfähige offene Modelle lokal betreiben – mit allen Vorteilen bei Datenkontrolle und Kosteneffizienz, die wir bereits besprochen haben.

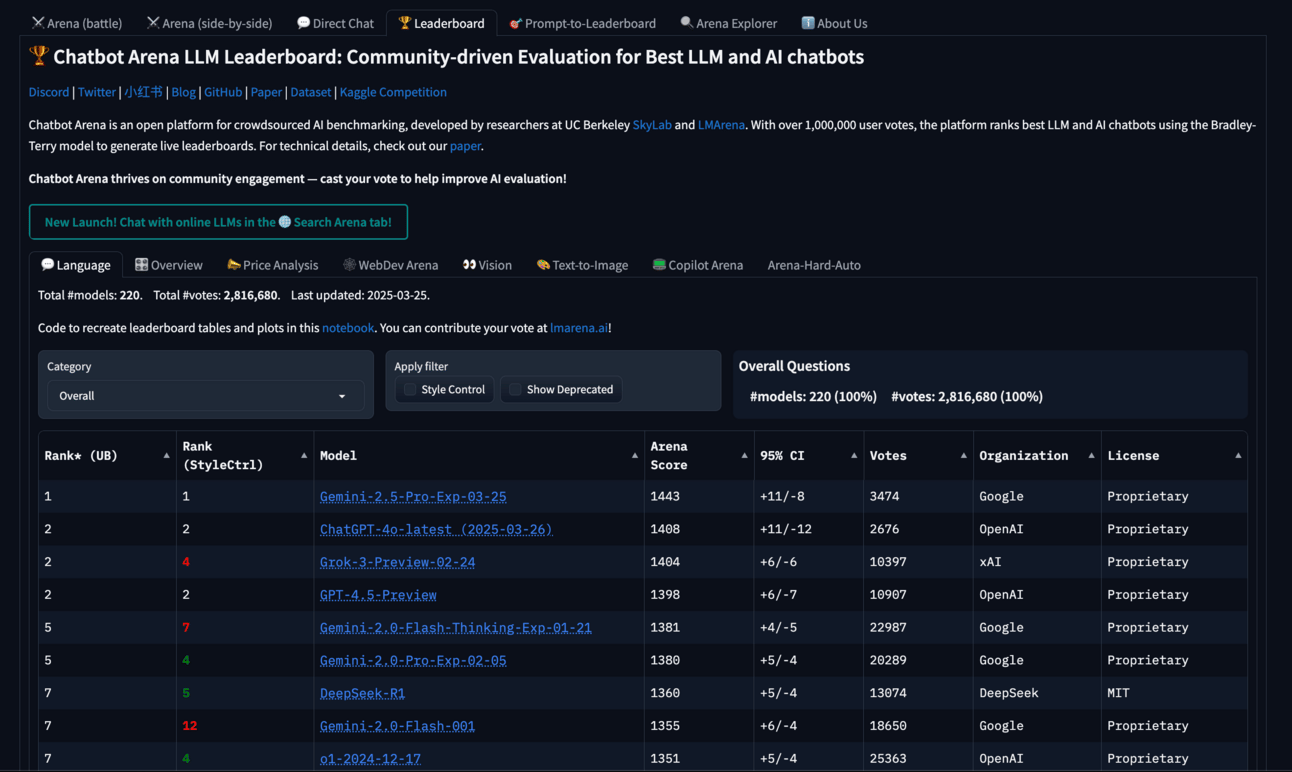

https://lmarena.ai/ - Das Leaderboard der LLM

übrigens: Ich bin nach wie vor überzeugt: Die Zukunft gehört nicht mehr dem Tippen und Klicken, sondern dem natürlichen Gespräch mit intelligenten Systemen. Wir stehen am Beginn einer Ära, in der die Grenzen zwischen Mensch und Maschine durch Sprache neu definiert werden – einer Ära, in der wir mit unseren Computern nicht mehr über Tastaturen und Mäuse kommunizieren, sondern durch die natürlichste Form der menschlichen Interaktion: das Gespräch.

Und wenn Du mit mir zusammenarbeiten willst: melde Dich gerne www.rogerbasler.ch

Disclaimer: Dieser Artikel wurde nach meinem eigenen Wissen und dann mit Recherchen mit KI (Perplexity.Ai und Gemini.Google.com) manuell zusammengestellt und mit Deepl.com/write vereinfacht. Der Text wird dann nochmals von zwei Personen meiner Wahl gelesen und kritisch hinterfragt. Das Bild stammt von Ideogram und ist selbst erstellt. Dieser Artikel ist rein edukativ und erhebt keinen Anspruch auf Vollständigkeit. Bitte melde dich, wenn Du Ungenauigkeiten feststellst, danke.

Quelle und weitere Informationen:

[…] https://www.computerweekly.com/de/definition/Retrieval-augmented-Generation-RAG - Grundlegende Erklärung der RAG-Technologie zur Verbesserung von KI-Antworten

[…] https://www.ki-company.ai/en/blog-beitraege/the-5-best-open-source-ai-models-in-2025 - Überblick über führende Open-Source-Modelle wie DeepSeek R1

[…] https://en.wikipedia.org/wiki/GPT-4o - Informationen zu GPT-4o, dem neuesten Modell von OpenAI

[…] https://blog.google/technology/google-deepmind/gemini-model-thinking-updates-march-2025/ - Details zu Googles Gemini 2.5 Pro

[…] https://t3n.de/news/ki-training-am-limit-warum-minderwerige-daten-die-zukunft-der-kuenstlichen-intelligenz-gefaehrden-1658335/ - Beleuchtet die zunehmende Knappheit hochwertiger Trainingsdaten

[…] https://blog.iao.fraunhofer.de/die-achilles-ferse-der-ki-regulierung-diskriminierungsschutz-bei-hochrisiko-systemen/ - Analysiert die Problematik von Bias und Diskriminierung in KI-Systemen